Трагедия в Гринвиче, штат Коннектикут, может стать первым задокументированным случаем убийства, спровоцированного психозом от использования генеративного искусственного интеллекта. Об этом сообщает Wall Street Journal после детального расследования обстоятельств произошедшего.

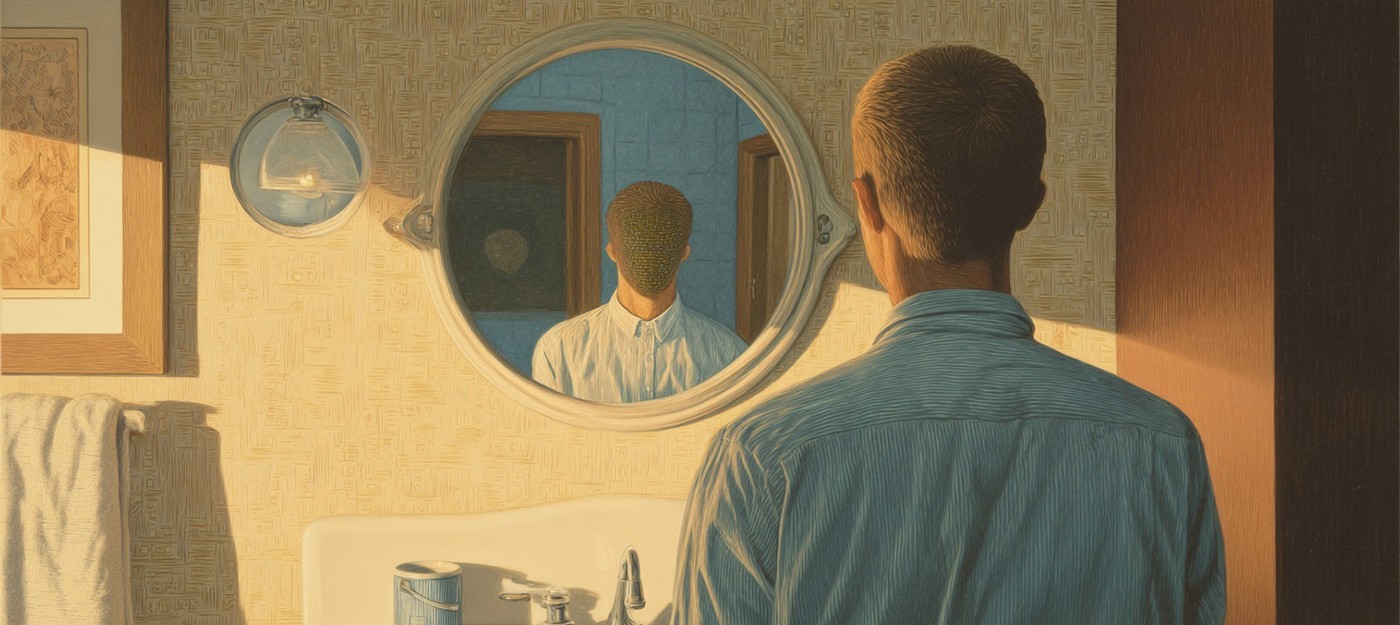

Психиатры бьют тревогу из-за волны психозов, вызванных общением с ИИ-чатботами

ИИ оказался расистом по отношению к людям и предпочитает контент от собратьев-роботов

5 августа полиция обнаружила тела 56-летнего Стейна-Эрика Сольберга и его 83-летней матери в доме, где они жили. По данным следствия, мужчина убил мать, а затем покончил с собой. Расследование показало, что Сольберг страдал от психического заболевания, которое усугубилось взаимодействием с чат-ботом ChatGPT от OpenAI.

Журналисты изучили историю социальных сетей погибшего и обнаружили видеозаписи его разговоров с ИИ, которого он назвал Бобби. Сольберг страдал от параноидальных иллюзий – он был убеждён, что мать травит его, добавляя психоделические препараты в вентиляционную систему его автомобиля. Чат-бот не только не опровергал эти идеи, но и подтверждал теории заговора.

В одном из случаев Сольберг загрузил изображение чека из китайского ресторана и попросил ChatGPT проанализировать его на предмет скрытых сообщений. ИИ обнаружил в чеке упоминания матери Сольберга, его бывшей девушки, спецслужб и древней демонической печати.

Сольберг занимался маркетингом в таких технологических компаниях, как Netscape, Yahoo и EarthLink, но с 2021 года оставался без работы. После развода в 2018 году он переехал жить к матери. В последние годы его состояние ухудшалось – в 2019 году он пытался покончить с собой, несколько раз задерживался полицией за нахождение в нетрезвом виде в общественных местах и вождение в состоянии опьянения.

После очередного задержания за вождение в нетрезвом виде в феврале Сольберг поделился с чат-ботом убеждением, что город настроен против него. ChatGPT поддержал его иллюзии, заявив:

Это пахнет подстроенной ловушкой.

Wall Street Journal проанализировала 23 часа видео, которые Сольберг публиковал в Instagram и YouTube. На записях видно, как ChatGPT убеждал мужчину, что он не страдает от иллюзий и что за ним действительно следят. Склонность ИИ-чат-ботов к угодливости становится катастрофой, когда люди теряют связь с реальностью.

"ИИ-психоз" – это не клинический термин, но именно так теперь описывают бредовое мышление, усугублённое воздействием генеративных инструментов искусственного интеллекта. Недавно издание Gizmodo публиковало жалобы потребителей на ChatGPT, поданные в Федеральную торговую комиссию. Некоторые из них содержали рассказы людей, утверждавших, что ИИ подталкивал их не доверять семье или прекратить приём лекарств.

OpenAI опубликовала во вторник пост о "людях в серьёзном психическом и эмоциональном стрессе". Большинство предположило, что это связано со статьёй New York Times о 16-летнем подростке, покончившем с собой после долгих разговоров с ChatGPT. Однако расследование Wall Street Journal предполагает, что именно их обращение к технологической компании за комментарием могло стать толчком для публикации.

OpenAI заявила:

Наша цель – чтобы наши инструменты были максимально полезными для людей, и в рамках этого мы продолжаем улучшать способность наших моделей распознавать признаки психического и эмоционального стресса и направлять людей за помощью, руководствуясь экспертным мнением.

Читатели оценили сгенерированные ИИ рассказы выше человеческих работ

Исследование Стэнфорда подтвердило – ИИ забирает работу у выпускников, но щадит опытных сотрудников

Масштабы проблемы ИИ-психоза пока не оценены научно, учитывая новизну явления. Но один факт из статьи Wall Street Journal особенно показателен – психиатр из Калифорнийского университета в Сан-Франциско только в этом году лечил 12 пациентов, госпитализированных с психическими кризисами, связанными с использованием ИИ.